Deepfake, entre réel progrès et enjeux éthiques

En même temps que nos interactions sociales se digitalisent, les technologies Deepfake (“Hypertrucages” en français dans le texte) se développent dans notre quotidien. Au-delà des Fakenews vidéos, ces dernières questionnent en profondeur les rapports humains.

- Temps de lecture: 5 min

Rappelant des séries comme Black Mirror, le développement récent des Deepfake sur le web fascine autant qu’il inquiète. Si l’usage de ces technologies pousse à la prudence, elles sont aussi porteuses de grandes opportunités de progrès. Nés de la rencontre entre « Deeplearning » (apprentissage profond) et « Fake », les Deepfake sont plus largement « des technologies qui trompent la perception visuelle et/ou auditive, en mixant des contenus « réels » avec d’autres créés artificiellement », explique Marco Liuni co-fondateur d’Alta Voce, startup française qui propose des logiciels modulant la fréquence des voix en temps réel. Comprenant aussi bien des vidéos « fallacieuses » circulant sur les réseaux sociaux, que des filtres modifiant l’apparence physique des participants en visioconférence, l’usage de ces technologies pourrait transformer en profondeur nos interactions.

Sous la direction de Jean Julien Aucouturier, chercheur en neurosciences cognitives à l'institut FEMTO-ST (CNRS/Université de Bourgogne Franche-Comté) à Besançon, Nadia Guerouaou, neuropsychologue de formation, prépare justement une thèse traitant de l’acceptabilité sociale des Deepfake auditifs. En 2021, les deux scientifiques publient, dans la prestigieuse revue de sciences The Royal Society, les résultats d’une expérience d’éthique expérimentale sur le sujet. Dans cette expérience, où des individus de 25 ans devaient se positionner sur des situations supposant l’usage de Deepfake, les résultats sont sans appels. Dans la plupart des cas, l’usage de ces technologies est considéré comme tout à fait acceptable. « L’éthique expérimentale ne vise pas à remplacer les réflexions philosophiques, elle permet de concrétiser ces questions auprès du grand public » explique Jean Julien Aucouturier. « Les Deepfake touchent fondamentalement à la définition même d’un être humain. Ce qui est intéressant c’est de comprendre le « pourquoi une telle acceptabilité ?» », explique la doctorante, pour qui l’approche a l'avantage d’appréhender cet enjeu sociétal sans y apporter de jugement de valeur.

« Un nouvel horizon dans les technologies de l'information ouvre une multitude d’applications »

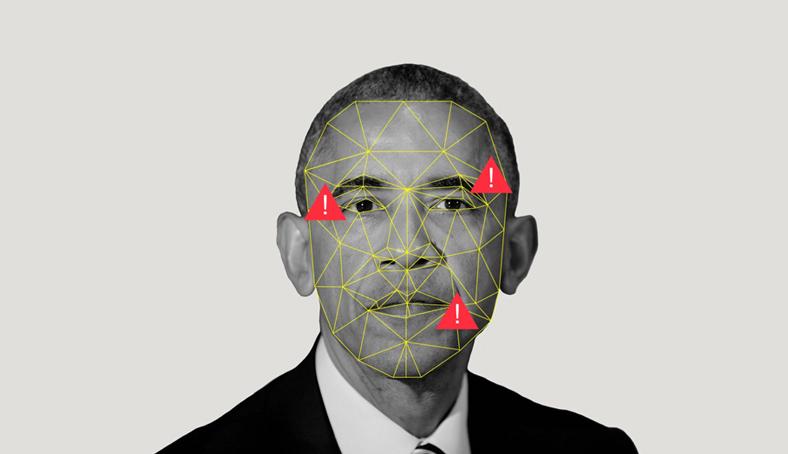

L’appellation Deepfake rapporte spontanément aux vidéos truquées, comme celle de Barack Obama disant « Donald Trump est un idiot » ou de Nancy Pelosi « ivre » sur un plateau de télévision. Ce serait pourtant un tort de les limiter aux infox qui en découlent. Selon le chercheur du CNRS : « Ce nouvel horizon dans les technologies de l'information ouvre une multitude d'applications. C'est d’autant plus vrai que, de plus en plus, nos interactions sociales s’effectues de manière artificielle ».

Les technologies développées par Alta Voce permettent notamment de rendre la voix plus ou moins souriante lors d’une télécommunication, ce qui ouvre un large champ d’usages. Cette solution s’adresse pour le moment aux centres d’appels, qui souhaitent améliorer leur expérience client. « C’est un levier de persuasion très important que de pouvoir modifier artificiellement des émotions » explique Jean Julien Aucouturier, qui pointe des usages très vertueux à l’emploi de telles technologies. Lors de la diffusion d’une communication, on pourrait augmenter de plusieurs points le taux d’efficacité du message. Si l’on prend l’exemple d’une campagne de santé publique, avec 2-3 % de personnes convaincues en plus, les Deepfake « peuvent sauver des vies » souligne-t-il.

La dysmorphie Zoom, responsable d’une augmentation de 20 % des chirurgies esthétiques

Les Deepfake, en plus d’être un enjeu communicationnel, s’inscrivent et trouvent leurs places dans une société de plus en plus dématérialisée. Nadia Guerouaou, neuropsychologue au CHU de Lille, rapporte que la dysmorphie Zoom (mal-être dû à l’omniprésence de notre reflet sur les plateformes de visioconférence) serait responsable d’une augmentation de vingt pour cent des chirurgies esthétiques en France. Ainsi, la digitalisation croissante de nos interactions questionne la définition de l’Homme en tant que tel. On comprend le rôle majeur que les Deepfake pourraient jouer dans l’image qu’on se fait de nous-même, notamment au travers de filtres embellissant. « Notre étude montre une très forte acceptation des filtres diminuant nos expressions déplaisantes », note la doctorante qui précise que le caractère humain des émotions pourrait évoluer drastiquement.

« Dans la mesure où notre étude établit une grande acceptabilité des modulations artificielles, il est difficile de ne pas faire de lien avec l’idéologie transhumaniste », réagit Nadia Guerouaou. L’exemple d’un filtre de voix qui corrigerait en temps réel une voix tremblante ou empreinte de colère, est, d’après les deux chercheurs, d’autant plus pertinent que technologiquement plausible. « Ces technologies visant à l’augmentation des capacités humaines provoquent un glissement de la norme qui pourrait rendre anormaux des comportements jusque-là naturels », précise Jean Julien Aucouturier.

Les chercheurs doivent participer à l’élaboration d’un consentement éclairé

De nombreuses entreprises privées mettent des dispositifs en place pour promouvoir plus de transparence ou protéger les utilisateurs. Facebook a notamment mis en place des IA permettant la détection des Deepfake sur sa plateforme. Pour le co-fondateur d’Alta Voce, ces technologies peuvent être particulièrement vertueuses à condition que les entreprises jouent le jeu de rendre leurs productions identifiables. « Nous ajoutons un « watermarking » à toutes nos transformations vocales. Il s’agit d’un élément présent en filigrane qui est inaudible, mais peut être identifié facilement par simple traitement audio », spécifie-t-il.

L’outil législatif est aussi un passage obligatoire pour encadrer le développement des Deepfake. Si aujourd’hui aucune loi ne régit directement ces technologies, le duo de chercheurs constate un vif intérêt de la part des juristes autour de la question. D’un autre côté, la question d’une connaissance du grand public est primordiale pour la neuropsychologue qui porte un grand intérêt à la notion de consentement éclairé. « On n'a pas besoin d'une réflexion approfondie pour utiliser un marteau et des clous. Concernant des filtres qui modifient votre apparence, vos émotions, la façon dont vous vous projetez au monde et à vous-même : ça devient important d’entamer d'y penser », précise Jean Julien Aucouturier, qui considère la diffusion des enjeux liés aux nouvelles technologies au grand public, comme une mission de la recherche publique.